- 6.1. Spectre électromagnétique

- 6.2. Transmission d'ondes radio

- 6.3. Transmission de micro-ondes

- 6.4. Politique d'exploitation du spectre électromagnétique

- 6.5. Transmission d'ondes infrarouges et millimétriques

- 6.6. Transmission d'ondes lumineuses

- 6.7. Satellites de télécommunications

- 6.8. Satellites contre fibre optique

Nous pouvons préciser que la communication numérique sans fil moderne a fait son apparition dans les îles hawaïennes, c'est-à-dire là ou le système téléphonique traditionnel était inadapté, les utilisateurs étant séparés par l'océan.

Lorsque les électrons sont en mouvement, ils créent des ondes électromagnétiques qui peuvent se propager dans l'espace (même dans le vide). Ces ondes ont été identifiées et prévues par un physicien anglais du nom de James Clerk MAXWELL en 1865 et observées pour la première fois par le physicien Heinrich HERTZ en 1887.

Le nombre d'oscillation par seconde d'une onde est appelée fréquence, f, qui se mesure en Herz (Hz). La distance entre deux maxima (ou minima) consécutifs d'une onde est appelé longueur d'onde, dont le symbole universel est la lettre grecque lambda, λ

Dans le vide, toutes les ondes se propagent à la même vitesse, quelle que soit leur fréquence. Cette vitesse, celle de la lumière, c, est d'environ 3 x 108 m/s ou encore 30 cm/ns (nanoseconde). Aucun objet ni signal ne peut aller plus vite. Dans le cuivre ou la fibre optique, la rapidité de déplacement d'une onde tombe à 2/3 de cette valeur et devient légèrement dépendante de la fréquence.

La relation fondamentale entre λ, f et c (dans le vide) est donnée par l'expression : λf=c

Comme c est une constante, et si nous connaissons f, nous pouvons trouver λ, et vice versa. En général, lorsque λ est exprimé en mètres et f en MHz, on a : λf ≈300

Par exemple, la longueur d'une onde de 100 MHz est d'environ 3 mètres, et celle d'une onde à 1 000 MHz est de 0,3m. Celle d'une onde de 3 000 MHz est de 0,1m...

Sur le tabeau suivant, nous vous représentons l'utilisation du spectre électromagnétique pour la transmission d'informations par modulation d'amplitude, de fréquence ou de phase. Vous pouvez voir qu'il s'agit des ondes radio, des micro-ondes, des ondes infrarouges et de la lumière visible. . Les ondes correspondants aux régions ultraviolets, rayons X et rayons gamma seraient plus efficaces en raison de leurs fréquences élevées, mais elles sont difficiles à produire et à moduler, ne se propagent pas bien au travers des immeubles et présentent des dangers pour les êtres vivants.

Vous trouverez également dans ce tableau les dénominations officielles établies par l'UIT. Par exemple, la bande LF va de 1 à 10 Km (environ 30 Khz à 300 Khz).

Les sigles LF (Low Frequency), MF (Medium Frequency) et HF (High Frequency) désignent relativement les basses, moyennes et hautes fréquences. A l'époque où ces appellations ont été choisies, il est clair que personne ne s'attendait à ce que l'on puisse aller au delà de la bande des 10 MHz. Les bandes supérieures ont donc été nommées VHF, UHF, SHF, EHF et THF (Very, Ultra, Super, Extremely et Tremendously High-Frequency), respectivement pour les bandes de fréquences Très, Ultra, Super, Extrêmement et Enormément hautes. Au-delà, aucune désignation n'est prévue mais on pourrait utiliser incroyablement, étonnamment et prodigieusement hautes ?

Les régions du spectre électromagnétique et les bandes associées

Les ondes radios sont faciles à générer, peuvent parcourir de longues distances et pénètrent aisément à l'intérieur des immeubles. On comprend donc qu'elles soient largement utilisées pour les communications, en intérieur comme en extérieur. Elles sont de plus omnidirectionnelles ce qui signifie qu'elles peuvent se propager dans toutes les directions à partir de la source. Les antennes émettrices et réceptrices n'ont ainsi pas besoin d'être parfaitement alignées physiquement.

Etant donné que les ondes peuvent se propager sur de longues distances, l'interférences entre plusieurs utilisateurs pose un problème. C'est pourquoi les gourvernements exercent un contrôle strict en soumettant l'emploi des émetteurs radio à l'obtention d'une licence, avec une exception que nous verrons plus loin.

Dans les bandes VLF, LF et MF, les ondes radio se propagent en suivant la courbure terrestre, comme le montre le schéma suivant. Elles peuvent être détectées dans un rayons de 1 000 Km aux fréquences les plus basses et sur une distance moindre aux fréquences supérieures.

La radiodiffusion AM utilise la bande MF, raison pour laquelle les ondes d'une station AM, par exemple RMC, ne peuvent aisément être captées à Lille. A ces fréquences, les ondes pénètrent aussi facilement à l'intérieur des bâtiments, c'est pourquoi les postes radio portatifs fonctionnent en intérieur. Le problème principal que posent ces bandes pour la transmission des données est leur faible bande passante.

Dans les bandes VLF, LF et MF, les ondes radio suivent la courbure de la terre. Dans la bande passante HF, elles sont réfractées par l'ionosphère

Dans les bandes HF et VHF, les ondes de surfaces ont tendance à être absorbées par la Terre. Toutefois, celles qui atteignent l'ionosphère sont réfractées et renvoyées vers la Terre comme l'illustre la figure ci-dessus. Sous certaines conditions atmosphériques, les ondes peuvent rebondir plusieurs fois entre l'ionosphère et la surface terrestre. Ces bandes sont utilisées par les radio-amateurs pour transmettre sur de longues distances, ainsi que par les militaires.

Au-delà de 100 MHz, les ondes se propagent pratiquement en ligne droite et peuvent être étroitement concentrées. Le fait de concentrer toutes cette énergie en un faisceau fin au moyen d'une antenne parabolique (telle que celles utilisées pour la télévision par satellite) procure un meilleur rapport signal sur bruit, mais requiert que les antennes émettrices et réceptrices soient alignées avec précision l'une par rapport à l'autre. De plus cette directivité permet à une rangée d'antennes émettrices de communiquer avec une rangée d'antennes réceptrices sans qu'il y ait d'interférences entre les différentes liaisons, à condition de respecter certaines règles d'espacement. Les micro-ondes ont formé le coeur du système téléphonique longue distance pendant des décennies avant l'avènement de la fibre optique.

Etant donné que les micro-ondes se propagent en ligne droite, la surface courbe de la Terre peut devenir gênante si les tours émettrices et réceptrices sont trop éloignées. Il faut dans ce cas introduire des répéteurs à des distances régulières. Plus les tours sont hautes, plus elles peuvent être éloignées les unes des autres.

A la différences des ondes radios à basses fréquences, les micro-ondes ne traversent pas les murs.

Afin de faire face à la demande toujours plus forte en spectre, les opérateurs proposent des fréquences de plus en plus hautes. Emettre aux alentours de 10 GHz n'est plus exceptionnel, mais un nouveau problème apparaît aux alentours de 4 GHz : Les ondes dont la longueur n'est plus que de quelques cm sont absorbées par la pluie. La seule solution est de couper temporairement les liaisons qui souffrent de ce problème et de les contourner.

Les principaux avantages des micro-ondes par rapport à la fibre sont :

Aucune tranchée à creuser

Il suffit d'acquérir un petit bout de terrain tous les 50 Km afin d'y construire une tour hertzienne

Le coût est relativement faible. Installer deux tours (Deux gros mâts avec des haubans) avec une antenne sur chacune d'elle, coûte moins cher que d'enterrer 50 Km de fibre

Tout le monde veut des débits plus élevés, donc plus de spectre. Afin d'éviter le chaos, il existe des accords nationaux et internationaux qui régissent l'attribution des fréquences. Chaque pays s'occupe d'allouer les bandes de fréquences pour la radio AM et FM, pour la télévision et la téléphonie mobile, pour les services de polices, maritimes, militaires et de navigation, ainsi qu'aux opérateurs de télécommunications, aux organes gouvernementaux et à bien d'autres utilisateurs demandeurs (les radio-amateurs par ex.)

Au niveau mondial, la WARC (Worldwide Administrative Radio Conference) tente de coordonner ces allocations pour permettre la fabrication d'équipements pouvant interopérer dans plusieurs pays. Toutefois, ces recommandations ne lient pas les pays. Les Etats-Unis elle même ont rejeté certaines de ces recommandations.

En Europe, c'est la CEPT (Conférence des postes et télécommunications) qui joue le rôle (entre autres) de gestion et régulation des radiocommunications avec l'ERO (Bureau Européen des radiocommunications).

En France, la DPT (Direction des Postes et Télécommunications) est chargée du pouvoir réglementaire général et l'ART (Autorité de Régulation des Télécommunications) et l'ANF (Agence Nationale des Fréquences) sont, respectivement, chargées d'attribuer les licences d'utilisation des fréquences aux utilisateurs et chargées d'assurer la planification, la gestion et le contrôle de l'utilisation du domaine public des fréquences radioélectriques.

Même lorsqu'une partie du spectre a été allouée pour une utilisation précise, par exemple pour la téléphonie mobile, se pose ensuite le problème de savoir quel opérateur est autorisé à exploiter quelles fréquences. On constate 3 méthodes :

La plus ancienne : Le concours de beauté (beauty contest). Elle nécessitait de la part des opérateurs intéressés qu'ils prouvent que leur proposition respectives répondaient le mieux aux intérêts du public. Des représentants du gouvernement choisissaient ensuite une proposition, n'hésitant pas, pour forcer certains choix, à recourir parfois à la subornation, la corruption, le népotisme, ou pire encore. Et si un fonctionnaire estimait qu'un opérateur pouvait offrir de meilleurs services, il devait longuement, très longuement le justifier.

Cette constatation a donné lieu à la deuxième méthode, le tirage au sort. Cette fois, le problème était que n'importe quelle société, même celle n'ayant aucune intention d'employer le spectre, pouvait participer au tirage. Par exemple, si une chaîne de restaurants ou de magasins de chaussures gagnait, elle pouvait revendre sa partie du spectre à un opérateur avec un bénéfice substantiel et sans aucun risque. Le fait que n'importe quelle société puisse ainsi engranger d'énormes profits simplement parce qu'elle est bien informée a été sévèrement critiqué, ce qui a conduit à la méthode suivante.

l'allocation des bandes de fréquences au plus offrant. Lorsque le gouvernement britannique a mis aux enchères les fréquences exploitables pour la troisième génération de téléphones portables en l'an 2000, il s'attendait à recevoir quatre milliards de dollars. Par peur de laisser passer leur chance, les opérateurs ont été pris d'une véritable frénésie et ce sont finalement 40 milliards de dollars qui sont tombés dans les caisses britanniques. Ce profit a inspiré d'autres gouvernements qui ont fait de même. Certains opérateurs se sont tellement endettés dans l'affaire qu'ils sont aujourd'hui proches de la faillite. Il faudra de nombreuses années pour qu'ils amortissent les sommes engagées dans les droits de licences. Vous trouverez dans le glossaire un court article sur l'attribution des licences d'exploitations de l'UMTS

Une autre méthode, à l'opposé des trois précités, est de ne pas allouer du tout de fréquences et de laisser tout le monde émettre à volonté, mais en contrôlant la puissance de transmission de façon à ce que les stations aient une portée suffisamment courte pour qu'il n'y ait pas d'interférences entre elles. Ainsi, la plupart des gouvernements ont réservé certaines bandes de fréquences, appelées ISM (Industrial, Scientific, Medical) pour une exploitation non soumise à licence pourvu que la puissance d'émission n'excède pas 10 mW et que l'émission ne soit pas continue.

Ces bandes ISM sont destinés à de multiples usages comme par exemple :

Les cellules qui commandent l'ouverture de la porte de garage

Les téléphones sans fil

Les jouets radioguidés

Les souris sans fils

De nombreux autres appareils ménagers sans fil

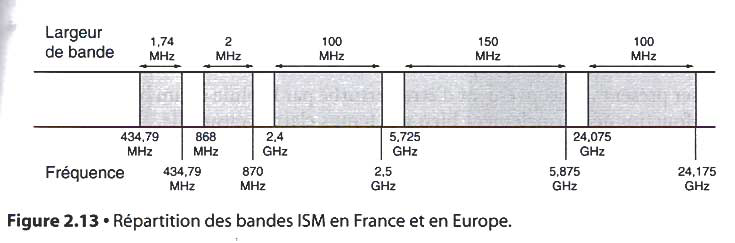

Le schéma ci-dessous vous montre la répartition des principales bandes ISM en Europe et en France. Les bandes les plus utilisées aujourd'hui sont celles des 433 MHz et des 868 MHz. Les plus prisées sont celles des 2,4 GHz et 5,8 GHz.

Répartition des bandes ISM en France et en Europe

Il faut savoir que la bande ISM est très encombrée et qu'elle est sujette à de nombreuses perturbations életromagnétiques, sans compter les problèmes de confidentialités et de sécurité des messages.

Elles sont largement utilisées pour les transmissions à faible portée, les télécommandes de téléviseurs par exemple. Elles sont assez directionnelles, peu coûteuses et simple à reproduire, mais ont pour inconvénient majeur de ne pas traverser les objets solides.

Cet inconvénient peut être vu comme un avantage, car un dispositif avec rayonnement infrarouge ne provoquera pas d'interférences avec un système semblable dans une autre pièce ou un autre immeuble. Vous ne pouvez pas contrôler la télévision de votre voisin avec votre télécommande.

Cela confère aux ondes infrarouges une bonne immunité contre les écoutes clandestines.

Ces ondes servent assez souvent à interconnecter des ordinateurs portables et des imprimantes. Elles n'ont qu'un rôle mineur dans le domaine de la communication.

La signalisation optique est utilisée depuis plusieurs siècles. Une de ses applications moderne est l'interconnexion de deux LAN situés dans des immeubles différents par l'intermédiaire de lasers placés sur leurs toit. Comme le laser produit une lumière cohérente et unidirectionnelle, chaque immeuble doit être équipé d'un laser et d'un photodétecteur. Un tel système offre une très large bande passante, est facile à installer, ne requiert pas de licence (contrairement aux micro-ondes).

La force du rayon laser, un faisceau très étroit, est aussi sa faiblesse. Viser avec un faisceau laser d'un millimètre de large une cible de la taille d'une tête d'épingle à une distance de 500 m est une prouesse. Afin de palier ce problème, les systèmes lasers sont généralement munis de lentilles qui réduisent légèrement la concentration du faisceau.

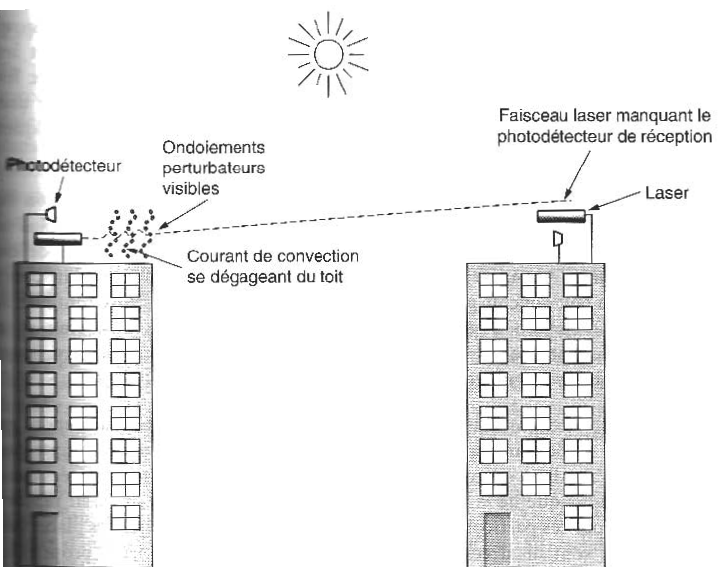

Le laser présente l'inconvénient d'être perturbé par la pluie ou un brouillard épais, mais fonctionne normalement bien par temps clair et ensoleillé. Il peut toutefois réagir de façon imprévisible en cas de grosse chaleur comme l'illustre le schéma suivant :

Un système de communication bidirectionnel par laser. Les courants de convection peuvent en perturber le faisceau

Dans les années 1950 et au début des années 1960, des expériences ont été menées pour tenter d'élaborer des systèmes de communications utilisant des ballons météorologiques métallisés pour réfléchir les signaux. Malheureusement, les signaux renvoyés étaient trop faibles pour être d'une quelconque utilité pratique. La marine américaine remarqua alors qu'elle disposait d'une sorte de ballon météorologique permanent : la Lune. elle développa un système opérationnel de communication entre la mer et la Terre qui se servait de cet astre comme d'une surface de réflexion.

L'évolution suivante dans le domaine des communications dans l'espace fut le lancement du premier satellite de télécommunication. La différence essentielle entre un satellite naturel et un satellite artificiel est que le second peut amplifier les signaux avant de les renvoyer.

Selon la 3eme loi de Kepler, la période orbitale d'un satellite varie en fonction du rayon de l'orbite à la puissance 3/2. Pour résumer, plus le satellite est éloigné de la terre, plus il mettra du temps à en faire le tour. A proximité de la surface terrestre, cette période est d'environ 90 minutes. Ainsi, les satellites à orbite basse ne sont visibles d'un court moment; Il en faut donc un grand nombre pour obtenir une couverture continue. A une altitude d'environ 35 800 Km, la période orbitale est de 24 heures et à 384 000 Km de distance, elle est d'environ 1 mois (comme peut en témoigner quiconque a observé la Lune).

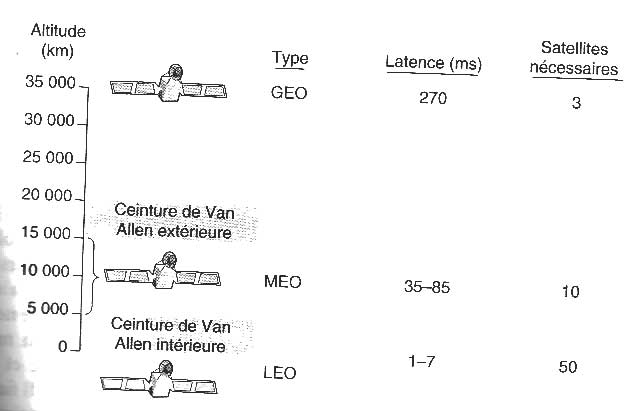

La ceinture de Van Allen est un autre facteur à prendre en compte. Son existence définit 3 zones dans lesquelles placer des satellites. Nous vous en résumons les emplacements dans le tableau suivant :

Les satellites de télécommunications et certaines de leurs propriétés (distance par rapport à la Terre, délai de transmission et nombre de satellites nécessaires pour une couverture globale)

En 1945, Arthur C. Clarke, qui n'était pas seulement un auteur de science fiction, a calculé qu'un satellite situé sur une orbite équatoriale circulaire à une altitude de 35 800 Km donnerait l'impression d'être immobile dans le ciel et ne nécessiterait aucun suivi. Par la même occasion, il décrivit même un système de communication complet qui utilisait ces satellites géostationnaires, y compris les positions orbitales, les panneaux solaires, les fréquences radio et les procédures de lancement. Il en concluait toutefois que l'emploi de tels engins était irréaliste, étant donné l'impossibilité de placer en orbite de fragiles amplificateurs à tubes, gourmands en énergie.

Les technologies actuelles font que les satellites GEO doivent être espacés par un angle d'au moins 2° sur le plan équatorial de 360°, afin d'éviter les risques d'interférence. Ainsi il ne peut y avoir que 360/2=180 satellites géostationnaires à la fois dans le ciel. Naturellement, chaque transpondeur peut utiliser plusieurs fréquences en même temps afin d'accroître la bande passante disponible.

Une fois encore, afin d'éviter le chaos total dans le ciel, l'UIT se charge d'attribuer les positions orbitales et leurs fréquences associées. Vous vous doutez bien que ce processus décisionnel est hautement politique.

Certains pays exigent de disposer de "leurs" positions orbitales (pour pouvoir ensuite le louer au plus offrant) alors que d'autres soutiennent que les droits de propriété de chaque nation ne s'appliquent pas jusqu'à la Lune et qu'aucun pays ne peut légalement revendiquer les positions orbitales qui se situent juste au dessus de son territoire. S'ajoute à cela le fait que les télécommunications commerciales ne constituent pas la seule application des satellites. Les sociétés de télévision, les gouvernements et l'armée se disputent également des parts de l'espace orbitale.

Tableau 4.1. Les principales bandes de fréquences assignées aux satellites

| Bande | Liaison descendante | Liaison montante | Bande passante | Problèmes |

|---|---|---|---|---|

| L | 1,5 GHz | 1,6 GHz | 15 MHz |

Faible bande passante encombrée |

| S | 1,9 GHz | 2,2 GHz | 70 MHz |

Faible bande passante encombrée |

| C | 4,0 GHz | 6,0 GHz | 500 MHz |

Interférences terrestres |

| Ku | 11 GHz | 14 GHz | 500 MHz |

Absorption par la pluie |

| Ka | 20 GHz | 30 GHz | 3 500 MHz |

Absorption par la pluie Coût des équipements |

Outre ces bandes commerciales, il en existe également de nombreuses réservées à une utilisation militaire ou gouvernementale.

Les premiers satellites possédaient un seul faisceau qui illuminait à peu près un tiers de la surface terrestre. La zone couverte portait le nom d'empreinte (footprint)

La chute des prix et des tailles des composants permettent aux satellites contemporains d'être équipés de plusieurs antennes et transpondeurs. Les faisceaux descendants sont désormais focalisés sur une plus petite étendue géographique de façon que plusieurs transmissions montantes et descendantes peuvent avoir lieu simultanément. Ces fasceaux concentrés sont appelés spots (spot beam) et forment à la surface de la terre plusieurs ellipses de quelques centaines de Km de diamètre seulement.

Ils se trouvent entre les deux ceintures de Van Allen. MEO (Medium-Earth Orbit)

Il leur faut environ 6 heures pour faire le tour de la terre.

Depuis le sol, on remarque qu'ils se déplacent longitudinalement

Les 24 satellites GPS (Global Positionning System) qui orbitent à 18 000 Km sont des exemples de satellites MEO

Du fait qu'ils ne sont pas actuellement exploités pour les télécommunications, nous n'en parlerons pas plus dans ce cours.

LEO (Low-Earth Orbit). En raison de leur déplacement rapide, il en faut un grand nombre pour former un système complet. En revanche, du fait de leur faible altitude, les stations terrestres n'ont pas besoin de beaucoup de puissance, et le délai de transmission est ramené à quelques millisecondes seulement.

Nous allons maintenant étudier 3 exemples d'applications de ces satellites (ou tentative d'exploitation).

En 1990, Motorola obtint l'autorisation de lancer 77 satellites LEO dans le cadre d'un projet baptisé Iridium (du nom du 77eme élément atomique). Le nombre de satellites fut ensuite ramené à 66 (le projet ne fut néanmoins pas renommé Dysprosium, un mystère du marketing)

L'idée de ce projet était qu'un satellite quittant le champ de vision d'ue station terrestre fût immédiatement remplacé par un autre satellite.

Ce programme provoca une frénésie chez les autres opérateurs de télécommunications qui voulurent tous imiter Motorola.

ce n'est que 7 ans plus tard, suite à de grandes difficultés à trouver des partenaires financiers, que les satellites Iridium furent lancés. En novembre 1998, les services commencèrent.

Août 1999, la société Iridium est déclarée en faillite. Les satellites et autres actifs (5 milliards de dollars) ont été acquis par un investisseurs pour 25 millions de dollars. Le réseau Iridium a repris du service en 2001 avec un nouveau coeur de cible et des tarifs à la baisse.

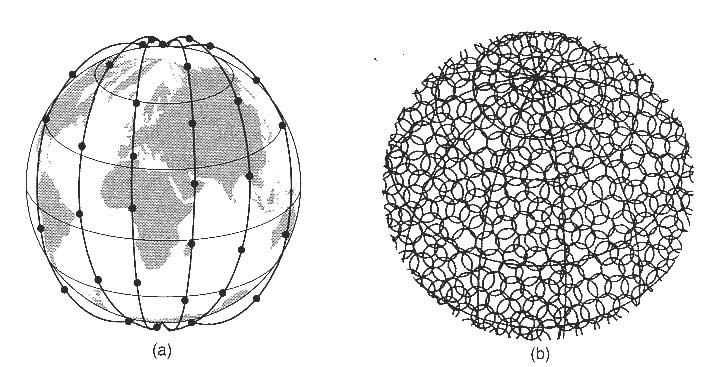

Les sattelites Iridium sont situés à 750 Km d'altitude sur des orbites polaires circulaires formant six colliers de perles d'axe Nord-Sud avec un satellite tous les 32 degrés de latitude. Ils couvrent ainsi la terre entière comme nous vous le montrons sur la figure suivante.

(a) les satellites iridium forment 6 colliers de perles autour de la terre

(b) 1 628 cellules en mouvement couvrent la planète

Chaque satellites comprends un maximum de 48 faisceaux de type spot, pour un total de 1 628 cellule couvrant la surface terrestre. Chacun dispose d'une capacité de 3 840 canaux, soit 253 440 au total. Certains canaux sont dédiés à la radiomessagerie et à la navigation, d'autres servent au transport de la voix et des données.

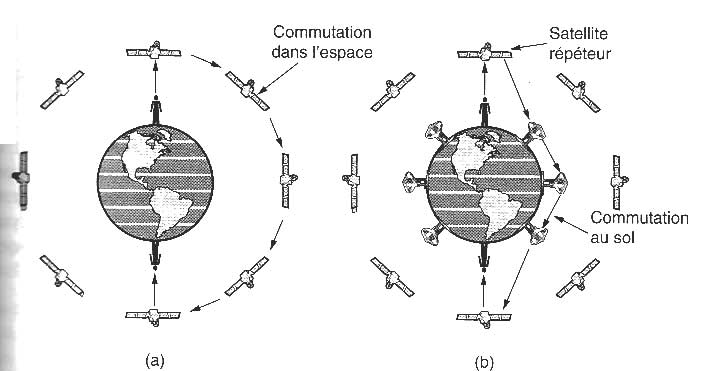

Une caractéristique du réseau Iridium est qu'une communication entre deux clients distants se déroule entièrement dans l'espace, les données étant relayées par les satellites intermédiaires, comme nous vous le montrons sur la figure ci-dessous :

(a) Relayage dans l'espace

(b) Relayage au sol

Dans cet exemple, un client au pôle Nord contacte un satellite situé juste au dessus de lui. L'appel est ensuite relayé par d'autres satellites, pour finalement atteindre un interlocuteur situé au pôle Sud.

Il existe d'autres systèmes de conception similaire, parmi lesquel Globalstar. formé d'une constellation de 48 satellites LEO, ce système n'emploie pas la même stratégie de commutation que le réseau Iridium. Alors que ce dernier relaie les appels de satellite en satellite, obligeant ceux-ci à êre doté d'équipements de commutation sophistiqué, Globalstar est fondé sur le modèle classique des satellites répéteurs. Comme nous vous l'avons montré sur la figure ci-dessus (dessin (b))

Notre troisième exemple, Teledesic, est un réseau mondial de satellites destiné aux utilisateurs de l'internet qui ont de fortes exigences en bande passante. Sa conception remonte à 1990. Elle fut imaginée conjointement par un pionner du secteur de la téléphonie mobiel, Craig McCaw, et par le fondateur de la société Microsoft, Bill Gates, ce dernier constatant que les sociétés de téléphonie mondiales tardaient à offrir aux utilisateurs d'ordinateurs de hauts débits de transmission. Le système Teledesic doit fournir simultanément à des millions d'internautes une liaison montante de 100 Mbts/s et une liaison descendante de 720 Mbit/s au moyen d'une petite antenne fixe de type VSAT, contournant ainsi totalement le système téléphonique existant. Inutile de dire que les opérateurs téléphoniques n'y voient que de belles promesses.

La conception initiale du système prévoyait 288 satellites à empreinte étroite, organisés sur 12 plans juste en-dessous de la ceinture de Van Allen intérieure, à 1 350 km d'altitude. Elle a été modifiée pour ne compter que 30 satellites à larges empreinte. Les transmissions se feront sur la bande Ka, qui offre un débit élevé et qui est relativement peut utilisée. Le système est fondé sur la communication par paquets. Les paquets seront commutés dans l'espace par les satellites qui seront capables de router le trafic vers leurs voisins. Un utilisateur désireux d'envoyer des paquets se verra allouer dynamiquement la bande passante nécessaire en approximativement 50 ms. A aujorud'hui, Teledesic est quasiment abandonné.

Il y a seulement 20 ans, on pouvait penser que les satellites étaient l'avenir des télécommunications. après tout, le système téléphonique n'avait que peut évolué en cent ans et on ne prévoyait aucun changement pour le siècle suivant. Cette inertie était dut en grande partie à la politique menée par les autorités de régulation. En effet, celles-ci demandaient aux opérateurs téléphoniques d'offrir des services de communication vocale de qualité à des prix raisonnables (ce qu'ils ont fait), en échange de quoi ils avaient l'assurance de voir leur investissements rentabilisés. Les personnes souhaitant transmettre des données à cette époque ne disposaient que de modems à 1 200 bit/s.

L'ouverture du marché des télécommunications aux États-Unis en 1984, et un peu plus tard en Europe, changea radicalement la donne. Les opérateurs téléphoniques entreprirent de remplacer leurs réseaux longue distance par de la fibre optique et introduisirent des services à haut débits tels que l'ADSL 'Assymmetric Digital Subscriber Line). Ils renoncèrent également à surfacturer les communications interurbaines au profit des communications locales.

Du coup, la fibre optique devint la technologie d'interconnexion de l'avenir. Il n'en reste pas moins que les satellites sont présents sur plusieurs niches majeures du marché

Les satellites présentent un intérêt certain pour la télécommunication mobile afin de permettre à quiconque de communiqure en tout lieu, en toute situation.

Dans des zones difficilement accessibles ou disposant d'une infrastructure terrestre peu développée, l'emploi de satellites va de soi. L'Indonésie, par exemple, dispose de son propre satellite pour assurer les liaisons téléphoniques intérieures. Il était plus économique de lancer un seul satellite que de poser des milliers de câbles sous la mer pour relier les quelques 13 677 îles de l'archipel.

Les satellites peuvent aussi servir à couvrir des régions où l'autorisation de poser des fibres est trop difficile à obtenir ou trop coûteuse.

Enfin, lorsque le déploiement rapide d'une infrastructure de télécommunications est vital, comme c'est le cas pour l'armée, les satellites sont irremplaçables.